Generowanie spójnych wizualnie grafik z AI jest coraz prostsze – co pokazałem już w poprzednim artykule o Midjourney. A jak wygenerować kilka grafik z dokładnie tą samą postacią? Oto 3 (dość) proste sposoby.

Spis treści:

- Boom na wirtualnych influencerów?

- Robiliśmy to zanim to było (super)modne

- Metoda 1: spójna postać w prompcie

- Metoda 2: parametr --cref w Midjourney

- Metoda 3: wykorzystanie modeli lokalnych

- Jak wykorzystać generowanie spójnej postaci?

- Kto ma prawa autorskie do Twojej wygenerowanej postaci

- Podsumowanie w punktach

Zobacz też:

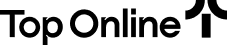

Boom na wirtualnych influencerów?

Skoro generowanie grafik z tą samą postacią, to wirtualni influencerzy – czyli nieistniejące realnie osoby, które „prowadzą” swoje kanały w mediach społecznościowych. Nierzadko z dużymi sukcesami.

O co chodzi?

Ten temat pojawił się w szerszej świadomości około 2016 roku, wraz z pojawieniem się postaci Lil Miqueli – jednej z pierwszych wirtualnych influencerek, która zdobyła masową popularność.

Jej sukces zainspirował firmy, które zaczęły tworzyć analogiczne postacie do celów marketingowych. Tak w latach 2017-2019 powstała m.in. Shudu (pierwsza wirtualna supermodelka) czy Imma.

Prawdziwy rozkwit pojawił się w czasie pandemii, gdy firmy chętnie inwestowały w współpracę z postaciami generowanymi komputerowo, które mogły wówczas (w przeciwieństwie do osób z krwi i kości) działać bez fizycznych ograniczeń.

W tym czasie powstawały influencerzy specjalizujący się w różnych dziedzinach, od mody po gry komputerowe. Całość przyspieszył gwałtowny rozwój AI i technologii deepfake.

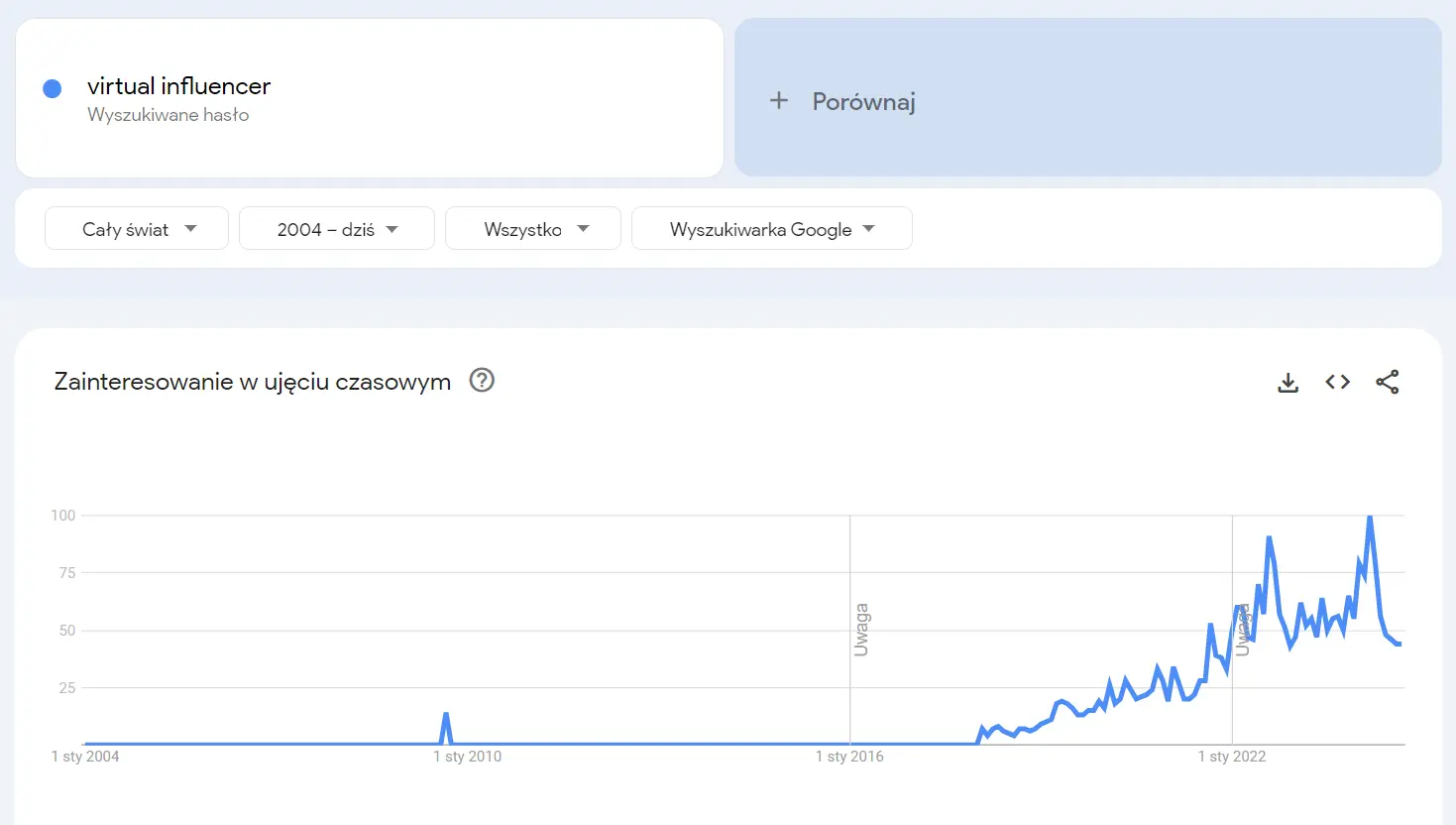

Prawdziwy pik zainteresowania wirtualnymi influencerami to jednak 2023 i Aitana, która stała się medialną sensacją… głównie za sprawą generowanych przez nią przychodów.

Już wtedy tworzenie takich postaci było w zasadzie w zasięgu każdego, kto miał dostęp do internetu, trochę samozaparcia i znał język angielski. Obecnie jest ono jednak jeszcze prostsze.

To wszystko oczywiście gigantyczny skrót (i pomijam tu kwestie etyczne, bo nie o tym jest ten artykuł), ale w skrócie: tak, jeśli trafiłeś/aś tutaj w tym celu, to z tego tekstu dowiesz się między innymi jak stworzyć wirtualnego influencera.

Choć do tego nie zachęcam, bo generowanie grafik z tą samą postacią można wykorzystać też do wielu innych rzeczy, o czym przeczytasz pod koniec tekstu :)

Robiliśmy to zanim to było (super)modne

Jeśli kojarzysz Top Online, to na pewno wiesz, że jesteśmy najbardziej zautomatyzowaną agencją SEO w Polsce, a jeśli nie… to też już wiesz :D

W każdym razie, nasze automatyzacje to nasz wyróżnik, dlatego, by móc się nimi chwalić bez nadmiernego tłumaczenia, zebraliśmy je w Inteligentnego Asystenta SEO.

Ten nie brzmiał jednak jakoś nadzwyczajnie intrygująco, a stał się dla nas bardzo ważny marketingowo, stąd postanowiliśmy nadać mu jakieś imię… a kolejno wygląd.

W dużym skrócie właśnie tak powstał Ignaś, który nie dość, że dzielnie pomaga nam prowadzić pozycjonowanie stron klientów, to jeszcze udziela się w marketingu firmy.

Dostał on swoją własną zakładkę na naszej stronie (polecam zobaczyć), a nawet wystąpił razem z Marcinem na konferencji I Love Automation & Tools:

Jeśli dobrze poszukasz, to znajdziesz go też w innych miejscach na naszej stronie :)

Więcej o tym jak zwizualizowaliśmy naszego robota - Ignasia przeczytasz w artykule Marcina. Tymczasem koniec chwalenia się – przejdę już do rzeczy.

Metoda 1: spójna postać w prompcie

Pierwsza metoda na generowanie grafik z tą samą postacią to po prostu stworzenie polecenia (promptu), w którym będę mógł zmieniać poszczególne elementy, zachowując przy tym tę samą postać.

Proces jest podobny do tego, który opisałem tutaj, przy okazji pisania promptu do zachowania tego samego stylu grafik, ale z doświadczenia: przy postaciach lepiej sprawdzają się polecenia ze zmiennymi.

Zmienne nie są tutaj żadną funkcją Midjourney, tylko elementami, które wstawiam w poleceniu tam, gdzie będę potem określał różne cechy przy kolejnych generowanych grafikach.

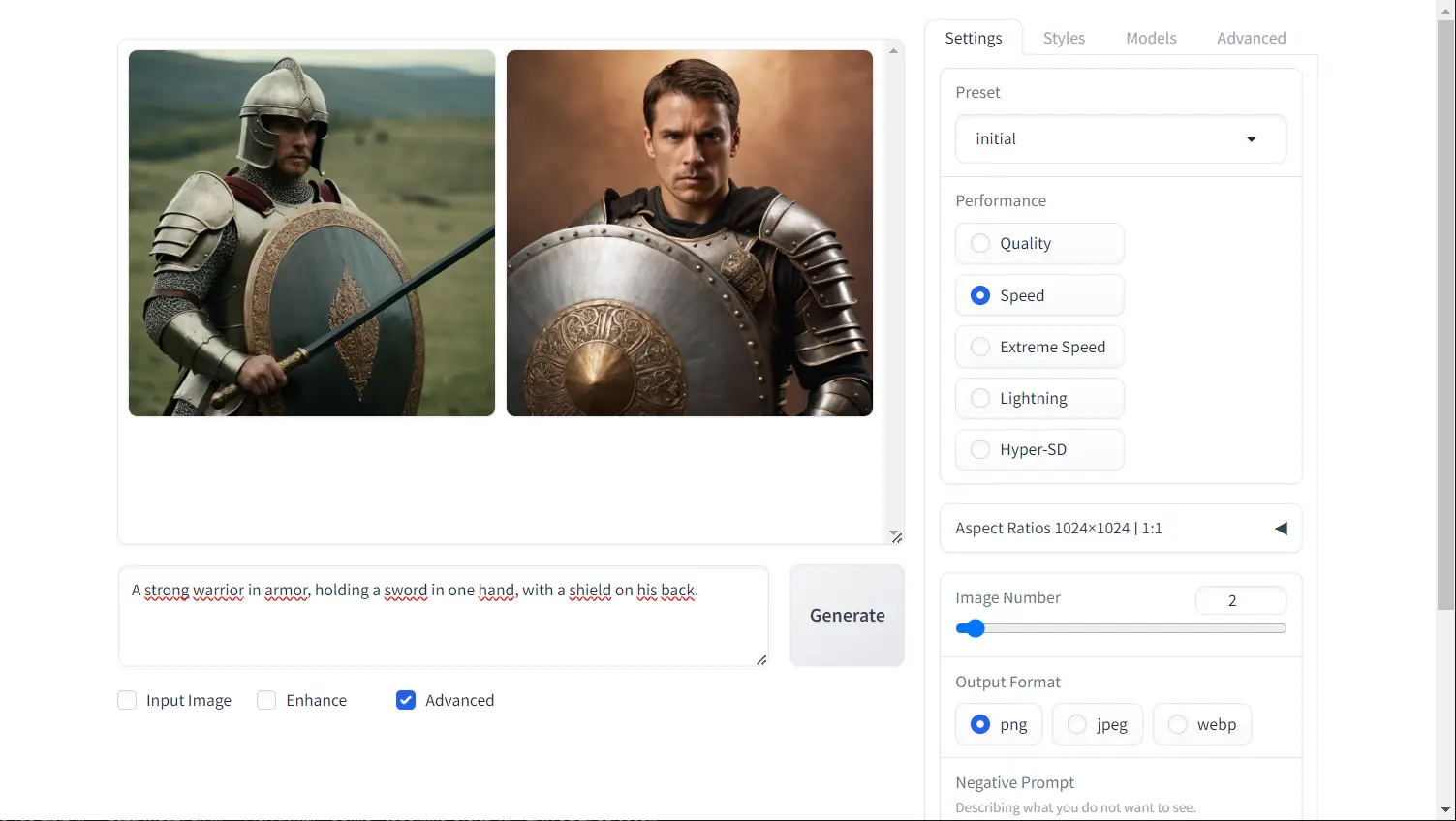

Na potrzeby tego artykułu, powiedzmy, że wygeneruję sobie stereotypowego wojownika, takiego jakby prosto z jakiejś fantastycznej sagi czy gry:

Bazowy prompt stworzyłem z pomocą naszego generatora promptów Midjourney i wygląda on tak:

A battle-hardened male warrior with rugged features, short black hair, and a thick, well-groomed beard. He has a muscular, imposing build. His facial expression is intense, with a deep scar running diagonally across his left cheek. He wields a massive, glowing broadsword in his right hand, and a circular shield strapped to his back. His armor is scratched and dented from countless battles, with intricate details. The background shows a fortress, with dramatic lighting that highlights the wear and tear on his gear, adding a sense of realism and tension to the scene.

Umieściłem w nim kolejno 5 zmiennych:

- [context] – czyli kontekst sytuacji i określenie pozycji, w jakiej ustawiona jest postać czy wyrazu jej twarzy.

- [outfit] – czyli ubiór mojej postaci, jeśli chciałbym zastosować inny niż zbroja.

- [armor type] – czyli rodzaj zbroi, no bo to w końcu wojownik, więc określenie konkretnej zbroi może być megaistotne.

- [color] – czyli kolor zbroi, żeby model nie generował różnych odcieni tego samego pancerza na różnych grafikach.

- [environment] – otoczenie, czyli sceneria i tło, w jakich znajduje się postać.

Warto wiedzieć

Dla większości postaci wystarczy tylko kontekst, ubiór i otoczenie.

Po zmianach prompt ze zmiennymi wygląda tak:

A battle-hardened male warrior with rugged features, short black hair, and a thick, well-groomed beard, [context]. He has a muscular, imposing build, wearing [outfit]. His facial expression is intense, with a deep scar running diagonally across his left cheek. He wields a massive, glowing broadsword in his right hand, and a circular shield strapped to his back. His armor is scratched and dented from countless battles, with intricate details of [armor type] and accents of [color]. The background shows [environment], with dramatic lighting that highlights the wear and tear on his gear, adding a sense of realism and tension to the scene.

Teraz każda zmiana w nawiasach pozwoli mi generować tę samą postać w różnych ubraniach, sytuacjach i otoczeniach. Wystarczy, że wpiszę w ich miejsce to, co chcę osiągnąć.

Poniżej parę przykładów:

Oto mój wojownik w trakcie walki:

Pod zmienne podstawiłem tutaj:

[context]: "standing in a defensive stance, ready for battle"

[outfit]: "heavy medieval plate armor with dark steel and gold inlays"

[armor type]: "ancient Roman-style armor"

[color]: "deep crimson"

[environment]: "a towering stone castle interior with flickering torches and banners"

Ten sam wojownik siedzący przy ognisku po przegranej bitwie:

Zmienne dla tej grafiki prezentują się tak:

[context]: "sitting by a crackling campfire at night"

[outfit]: "worn leather cloak draped over his shoulders and simple, battle-scarred armor underneath"

[armor type]: (nie dotyczy)

[color]: (nie dotyczy)

[environment]: "a dark, forested area with the glow of the fire casting warm, dancing shadows on the nearby trees"

No i kolejny, na łące, tym razem bez zbroi:

Tutaj zastosowałem takie zmienne:

[context]: "standing calmly in the middle of a vast, sunlit meadow"

[outfit]: "simple, weathered leather tunic and pants, with a belt carrying a sheathed sword"

[armor type]: (nie dotyczy)

[color]: (nie dotyczy)

[environment]: "a serene, open field with distant mountains and a clear blue sky"

I jeszcze jeden, po podróży w czasie i lekkim dostosowaniu do współczesnych realiów, w supermarkecie:

Zmienne:

[context]: "standing casually in a supermarket aisle"

[outfit]: "simple grey t-shirt and faded blue jeans"

[armor type]: (nie dotyczy)

[color]: (nie dotyczy)

[environment]: "a bright and modern supermarket with shelves filled with groceries, fluorescent lighting"

I na koniec przeniesiony do świata klocków Lego oraz ubrany w szlafrok, bo czemu nie:

Zmienne wyglądają tutaj tak:

[context]: "standing in a world made entirely of Lego bricks"

[outfit]: "comical, oversized bathrobe"

[armor type]: (nie dotyczy)

[color]: (nie dotyczy)

[environment]: "colorful Lego buildings and structures, with playful lighting and blocky, toy-like details"

Wiadomo, detale są jeszcze do dopracowania, ale ogólnie jest bardzo dobrze. Szczególnie, że prompt i wszystkie te przykłady stworzyłem w jakieś 20 minut.

Jak więc widać gołym okiem, dzięki takiej strukturze mogę dowolnie zmieniać fragmenty w nawiasach, a postać zawsze pozostanie ta sama, nawet jeśli przeniosę ją do kompletnie innego świata.

Takie podejście powinno działać bez problemu we w zasadzie każdym narzędziu pozwalającym generować grafiki za pomocą sztucznej inteligencji. Nie ważne, czy będzie to Midjourney, ChatGPT, Gemini czy coś jeszcze innego.

PRO TIP: niech ChatGPT zajmie się promptowaniem wariantów za Ciebie

Jeśli będziesz stosować to podejście, to po opracowaniu swojego polecenia kolejne warianty możesz tworzyć jeszcze łatwiej. Prosząc ChatGPT, Gemini czy inny LLM o przepisanie zmiennych tak, by postać była w konkretnej sytuacji.

Tutaj polecenie, które sam wykorzystałem do stworzenia grafik z przykładów:

Poniżej wklejam polecenie, które pozwala mi generować grafiki tej samej postaci w różnych wariantach w Midjourney:

Prompt:

(tutaj wklej swój prompt)

Przepisz to samo polecenie dostosowując zmienne w nawiasach kwadratowych ([]) tak, by postać (tutaj opisz sytuację). Nie zmieniaj innych elementów polecenia.

Warto wiedzieć

Jeśli sytuacja będzie bardzo abstrakcyjna, to LLM najprawdopodobniej zmieni też inne elementy polecenia – ale czasem mimo to i tak warto je wykorzystać.

W moim przypadku było tak przy wersji Lego (co zresztą nie powinno zaskakiwać), ale efekt mimo to był naprawdę świetny.

Umieszczenie zmiennych w prompcie także możesz zlecić AI, ale nie zawsze uda się to idealnie za pierwszym razem.

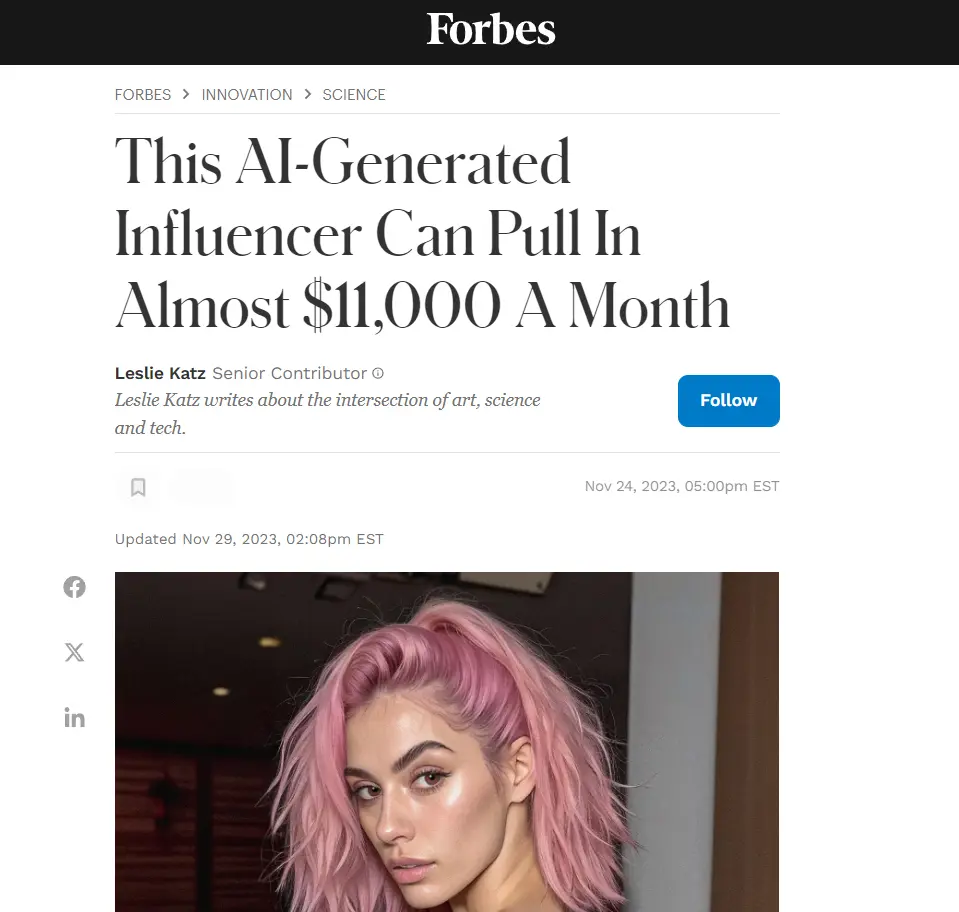

Metoda 2: parametr --cref w Midjourney

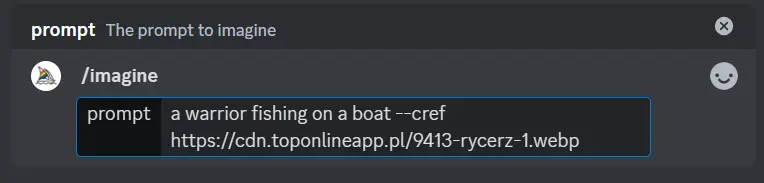

Druga metoda dotyczy już stricte Midjourney, a jest nią parametr Character Reference, który wyręczy mnie w całej zabawie z promptowaniem.

Działa on bardzo prosto: wystarczy, że na koniec polecenia dodam komendę „--cref” i wkleję adres URL do grafiki postaci, która ma znaleźć się na wygenerowanym obrazku.

Według dokumentacji Character reference działa najlepiej z grafikami pojedynczych postaci wygenerowanymi w Midjourney.

Warto wiedzieć

Funkcja --cref ma wbudowane zabezpieczenie przed używaniem w niej zdjęć prawdziwych ludzi.

Dla przykładu – wezmę sobie mojego wojownika:

Skopiuję URL tej grafiki i wykorzystam go w prompcie:

No i oto efekt:

Warto wiedzieć

Twoja postać wcale nie musi być człowiekiem! Może to być nawet zwierzak, pluszak, robot, czy cokolwiek tylko wpadnie Ci do głowy :)

Co ważne, obok parametru --cref działa też parametr Character weight (--cw 0-100), który pozwala określić, jak dokładnie odwzorowana ma być postać.

Domyślnie jest on ustawiony na 100, czyli maksymalne odwzorowanie. Przy zastosowaniu --cw 0 model odwzoruje tylko twarz postaci, a przy wyższych wartościach odpowiednio „mocno” także inne jej cechy.

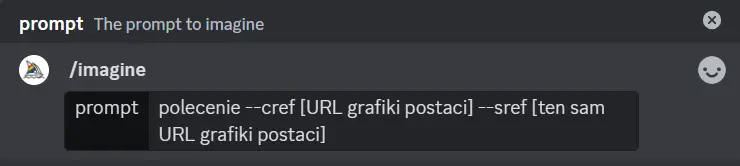

Z Character reference mogę połączyć również parametr Style reference, o którym pisałem już w poprzednim artykule o generowaniu spójnych grafik (link zostawiłem u góry, pod spisem treści).

Mogę użyć go „klasycznie”, z inną grafiką, której styl chcę uzyskać na grafice, ale i z samym obrazkiem przedstawiającym postać.

Jeśli np. zależy mi na tym, żeby postać była generowana zawsze w identycznym stylu co na grafice, której używam już w Character reference, to używam jej wtedy także w Style reference:

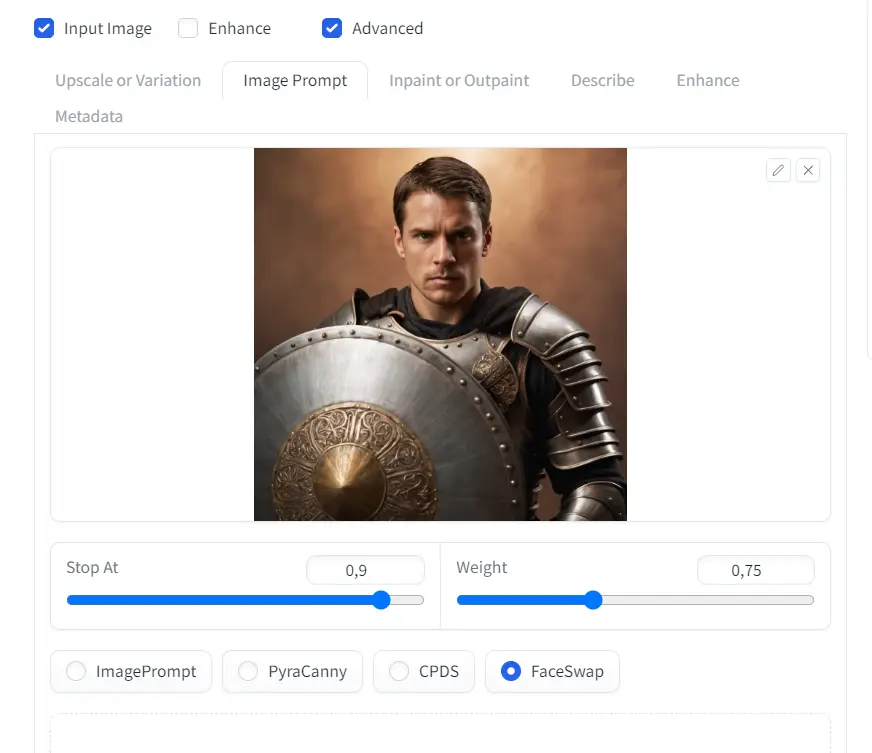

Metoda 3: wykorzystanie modeli lokalnych

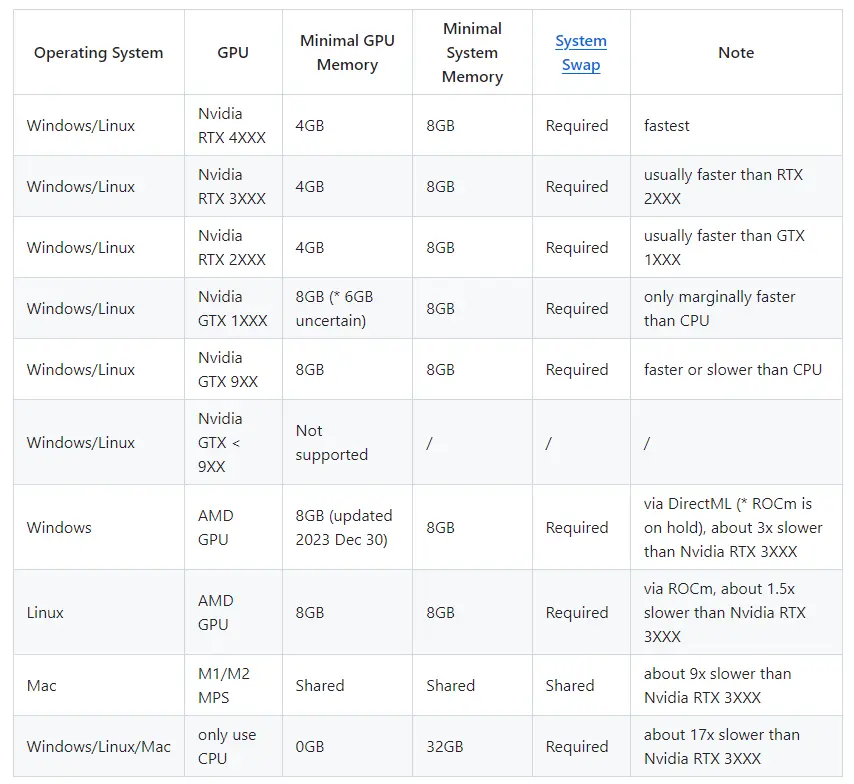

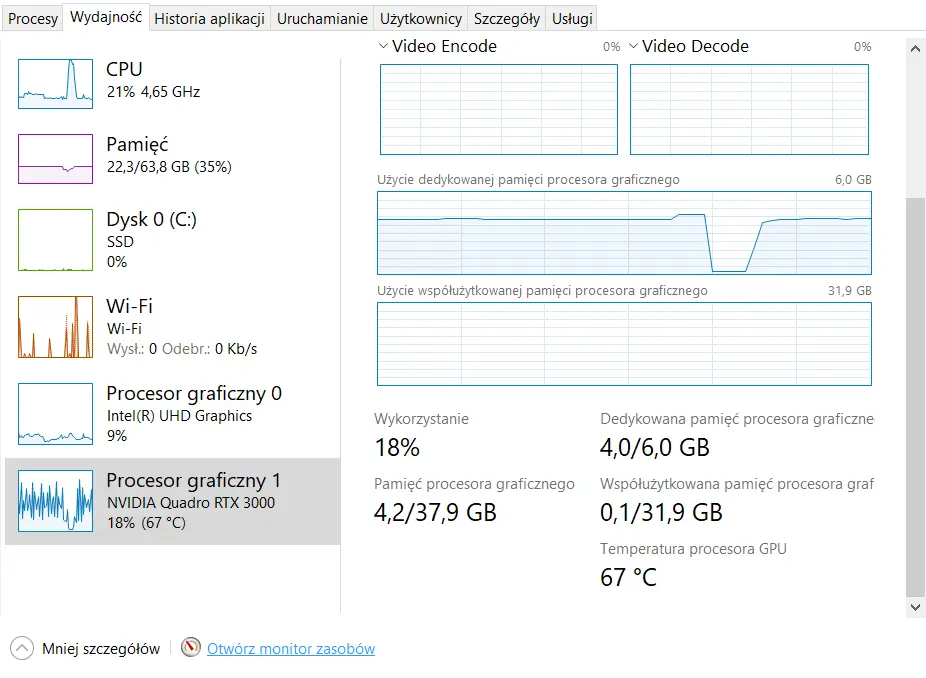

Trzecia metoda będzie najbardziej wymagająca… sprzętowo, bo skorzystam w niej z rozwiązania działającego lokalnie, na moim komputerze.

Wykorzystam w pełni darmowe oprogramowanie open-source Fooocus, które automatycznie pobiera i konfiguruje modele lokalne oraz dostarcza łatwy w obsłudze interfejs.

Na Windowsie instalacja ogranicza się tutaj do pobrania i uruchomienia instalatora. Na Macu i Linuxie sprawa jest trochę bardziej złożona, ale spokojnie: twórcy projektu zamieścili na GitHubie pełne instrukcje krok po kroku.

Zanim pobierzesz, upewnij się jednak, że Twój komputer spełnia minimalne wymagania techniczne:

Linki do pobrania wraz z instrukcjami instalacji znajdziesz tutaj: https://github.com/lllyasviel/Fooocus?tab=readme-ov-file#download

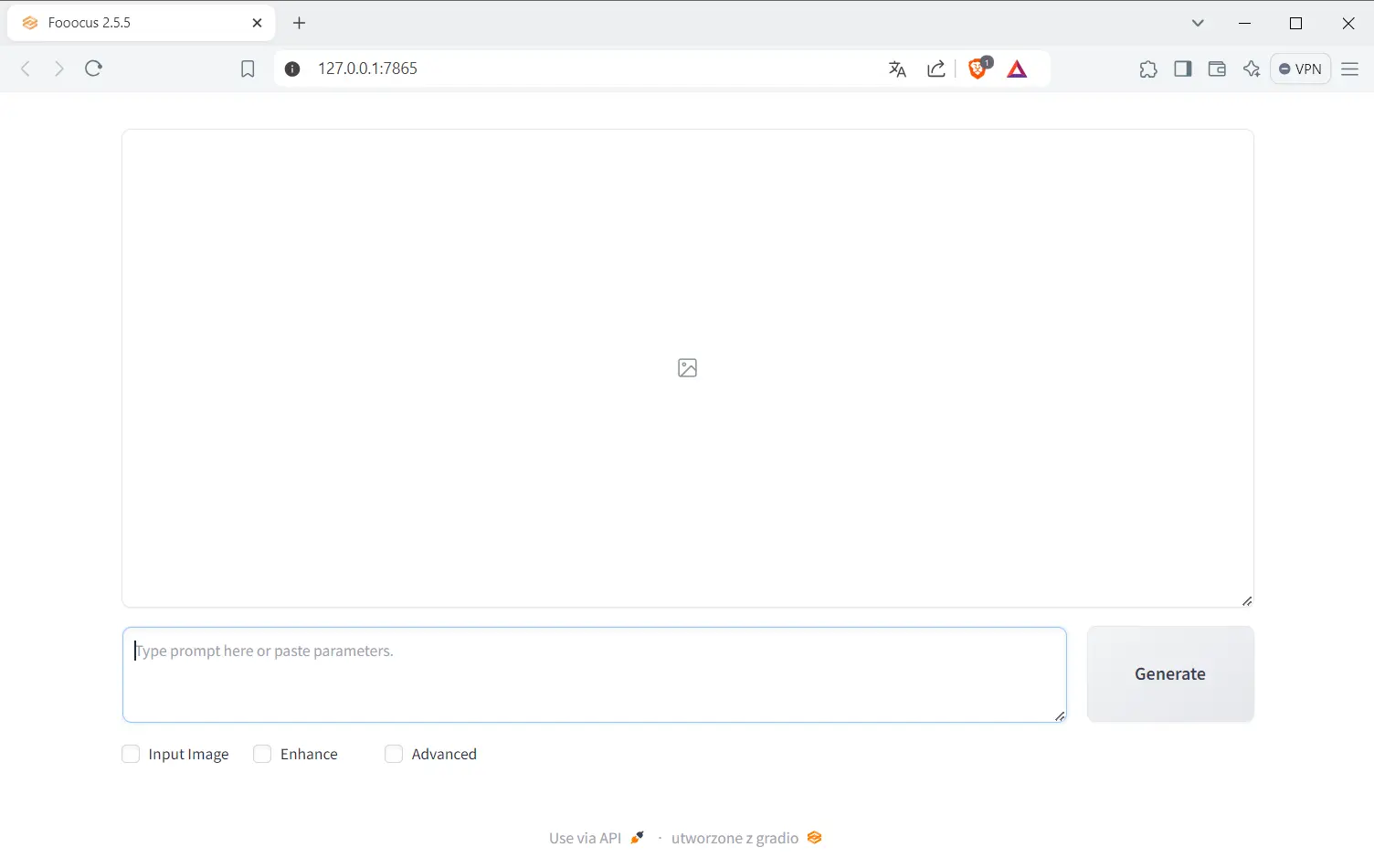

Po pobraniu, instalacji i uruchomieniu Fooocus samodzielnie otworzy interfejs w przeglądarce:

Teraz w zasadzie wystarczy wpisać prompt, tak samo jak w Midjourney czy ChatGPT i obraz zostanie wygenerowany.

Mnie jednak interesuje generowanie spójnych postaci, więc zaznaczam opcję „Advanced”, przechodzę do „Styles” i wybieram interesujący mnie styl (po najechaniu kursorem na opcje zobaczysz przykładowe grafiki w danym stylu).

Warto wiedzieć

Przy pierwszym uruchomieniu wybranie opcji „Advanced” uruchomi pobieranie dodatkowych zasobów, które może chwilę potrwać. Tak samo będzie przy wyborze innego stylu, presetu czy modelu.

Jeśli chcesz dostosować swoje generacje, to w ustawieniach jest tutaj dużo różnych opcji, które w Midjourney ustawia się głównie za pomocą parametrów w promptach (np. współczynnik proporcji grafiki – aspect ratio).

W sekcji Features na GitHubie projektu znajdziesz porównanie funkcji Fooocus z Midjourney (jest tam opisane szczegółowo co odpowiada której funkcji i gdzie to znaleźć).

Ja na potrzeby przykładu zostawiam ustawienia domyślne – zmieniam tylko aspect ratio na 1:1 i zaznaczam dodatkowo styl „Fooocus Photograph”. Nie mniej polecam pobawić się ustawieniami :).

Czas wygenerować postać:

Generowanie może potrwać tutaj dłużej niż w Midjourney, czy w innych rozwiązaniach (całość dzieje się na Twoim komputerze, więc wszystko zależy od mocy obliczeniowej Twojego sprzętu).

W każdym razie mam już postać. Jak więc teraz wygenerować inną grafikę ale z tą samą postacią?

Sprawa jest prosta:

- Zapisuję sobie grafikę mojej postaci na komputerze.

- Pod miejscem na prompt wybieram „Input image”.

- Wybieram „Image prompt” > „Advanced” (pod miejscem na przesłanie grafiki).

- Zaznaczam opcję „FaceSwap”.

- I przesyłam moją wygenerowaną wcześniej grafikę.

Całość powinna wyglądać tak:

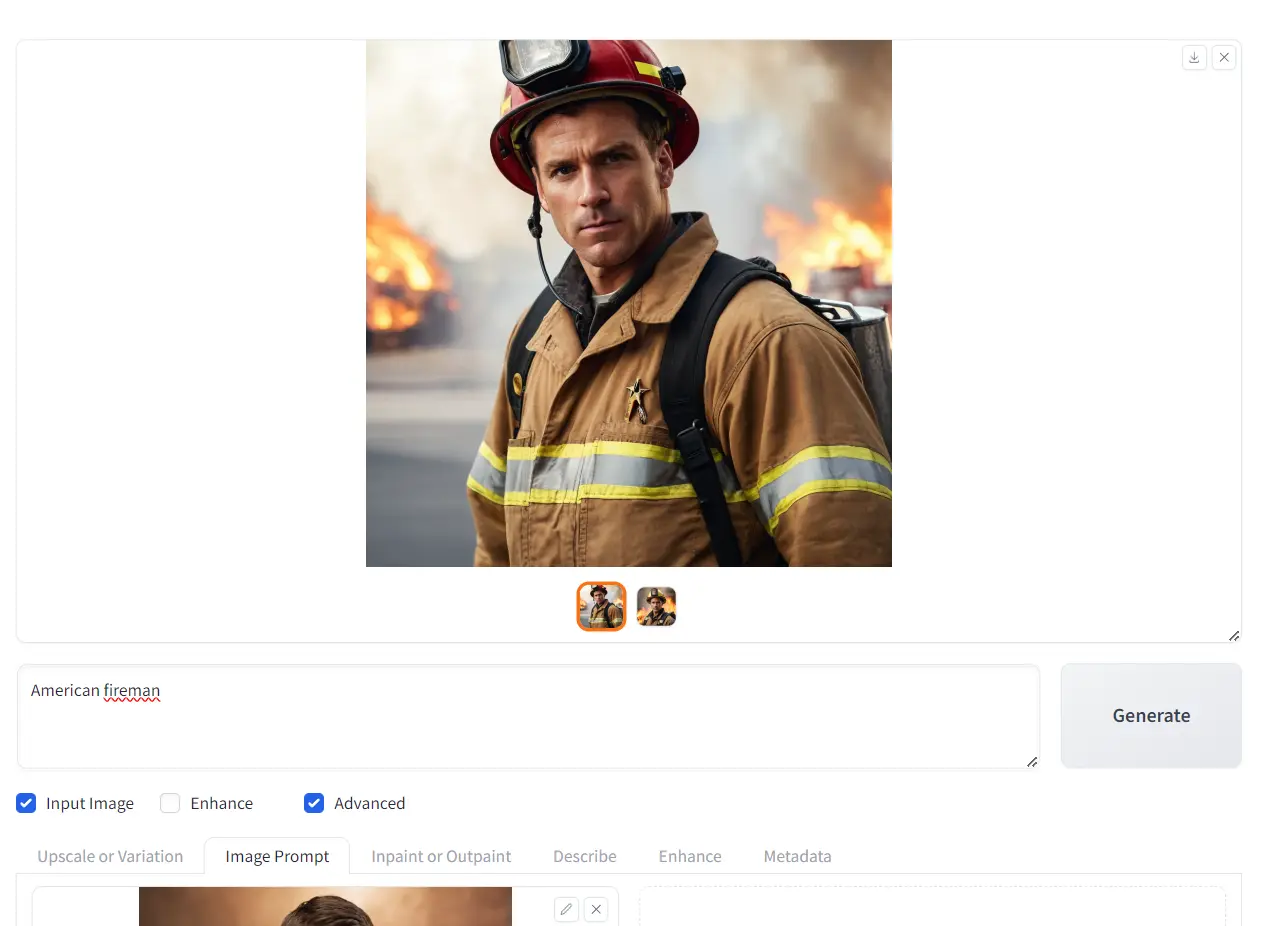

Teraz pozostaje już tylko wpisać prompt dla nowej grafiki z moją postacią i kliknąć „Generate”… no i gotowe! :D

Co ważne, Fooocus ma wbudowane opcje dopracowywania promptu, przez co świetnie radzi sobie nawet z bardzo prostymi poleceniami (jak zresztą widać na screenshocie powyżej).

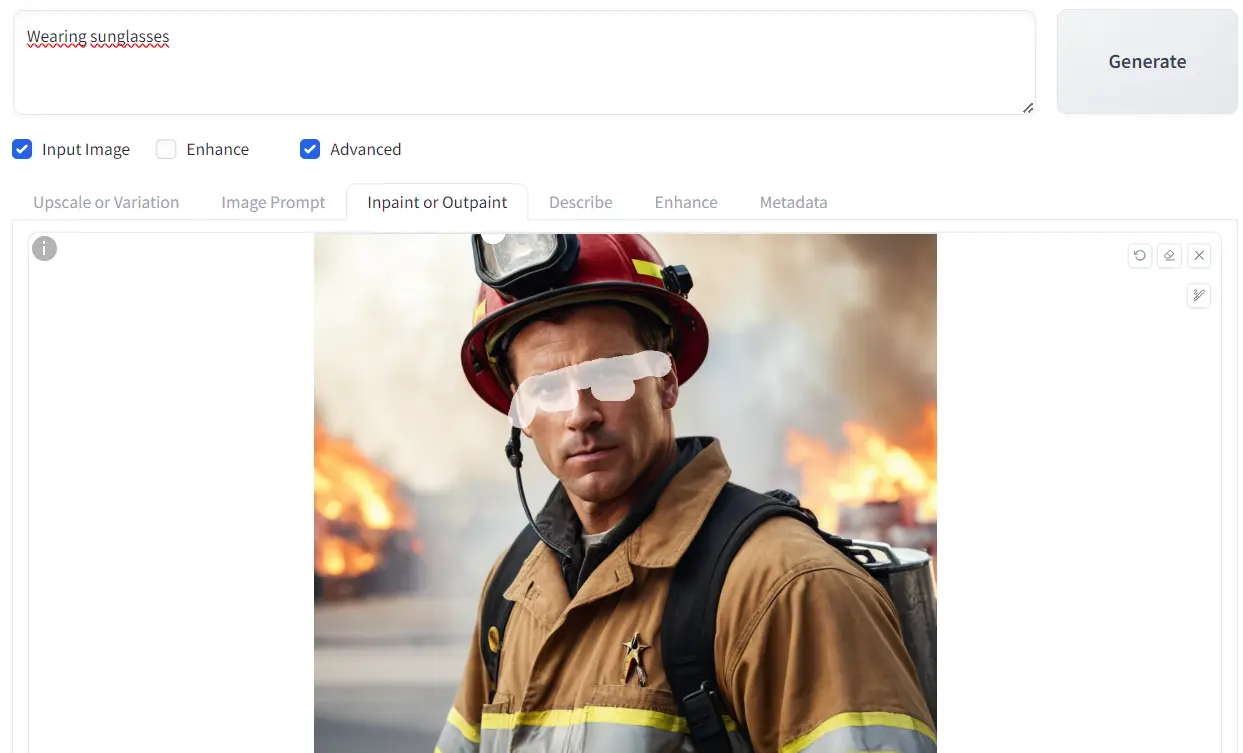

Jeśli na wygenerowanej grafice nie zgadzają się jakieś pojedyncze elementy, to mogę je też edytować, korzystając z opcji „Inpaint or Outpaint” (w „Input image”).

Warto wiedzieć

Zastosowanie lokalnego modelu jest bardziej czasochłonne, ale nie wymaga płacenia za usługę i daje znacznie większe możliwości.

Analogicznie do Fooocus możesz skorzystać z innych rozwiązań tego typu, np. Stable Diffusion WebUI lub Comfy UI. Fooocus jest z nich wszystkich jednak zdecydowanie najprostszy :).

Jak wykorzystać generowanie spójnej postaci?

Co do zastosowania generowania grafik ze spójnymi postaciami, to może nie koniecznie polecam tworzenie od razu kolejnego wirtualnego influencera (no chyba, że bardzo chcesz) :D.

Zamiast tego możesz na przykład…

Stwórz sobie brand hero

Generowanie grafik ze spójnymi postaciami możesz wykorzystać choćby po to, żeby stworzyć sobie brand hero! Tak jak my Ignasia.

Pamiętaj, że nie koniecznie musi być to człowiek. Równie dobrze sprawdzi się też jakieś zwierzątko czy postać kompletnie fantastyczna. Możesz nawet zlecić komuś taką kreację, a potem powielać ją sobie w różnych sytuacjach za pomocą AI.

Ważne tylko, żeby postać ta reprezentowała wartości Twojej marki i nie kojarzyła się negatywnie.

Stwórz ciekawe ilustracje do artykułów/kursów

Spójna postać może posłużyć do ilustracji tekstu, na przykład poradnika w sklepie internetowym.

Przykład?

Powiedzmy, że masz sklep ogrodniczy i robisz poradnik o przygotowaniu podwyższonych grządek.

Robisz ilustracje poszczególnych etapów, na których jest ta sama osoba. Całość wygląda super profesjonalnie, a nie wymaga wiele nakładu pracy i nie jest stockowa, jak u konkurencji – więc Cię wyróżnia :).

Warto wiedzieć

Grafiki ze spójnymi postaciami mogą stać się fajnym i niedrogim wyróżnikiem dla tekstów pisanych pod SEO.

Content na social media

Ze spójną postacią, minimalną umiejętnością obsługi programu do grafiki i szczyptą kreatywności możesz też łatwo tworzyć ilustracje do postów, memy czy nawet komiksy, na których pojawiają się te same postacie.

Kto ma prawa autorskie do Twojej wygenerowanej postaci

To dość grząski temat, ale w Polsce wirtualne postacie można rejestrować jako znaki towarowe. Nie mogą tylko one mieć cech innych, charakterystycznych i chronionych prawnie postaci. No i muszą mieć cechy charakterystyczne dla siebie.

Nie będę jednak udawał, że znam się na prawie. Bardzo rzetelny, fachowy i kompleksowy tekst na ten temat znajdziesz tutaj: Wirtualni influencerzy z perspektywy praw własności intelektualnej - Co w Prawie Piszczy.

Podsumowanie w punktach

- Choć nie musi służyć tylko do tego, to generowanie spójnych postaci na grafikach jest nierozłącznie związane z tematem wirtualnych influencerów.

- W Top Online temat ten zaczęliśmy zgłębiać, gdy zdecydowaliśmy, że musimy zwizualizować naszego Inteligentnego Asystenta SEO – Ignasia.

- Pierwszy sposób na spójne postacie w wygenerowanych grafikach to prompt ze zmiennymi, czyli miejscem na określenie np. tła, pozy, wyrazu twarzy czy ubioru postaci.

- Jest on dość trudny i pracochłonny, ale spokojnie można wspomagać się w nim np. ChatemGPT.

- Drugi sposób dotyczy stricte Midjourney i jest nim wykorzystanie specjalnie stworzonego do tego parametru Character Reference, który pozwala generować tę samą postać na podstawie przesłanej grafiki.

- Trzecia metoda z której korzystam to wykorzystanie modeli lokalnych, które dają zdecydowanie większe możliwości, ale wymagają sporej mocy obliczeniowej i mogą sprawiać trudności w instalacji czy obsłudze.

- Takie spójne postacie mają wiele zastosowań – od wirtualnych influencerów, przez brand heroes, po ilustrowanie tekstów czy tworzenie treści na social media.

- Kwestia praw autorskich do takich postaci jest dość złożona, ale ochrona prawna wygenerowanej postaci jest jak najbardziej możliwa.