Google wdrożyło aktualizację March Core Update. Koniec funkcji Google AI, znanej jako AI podczas przeglądania. LLMs.txt jako odpowiedź na robots.txt – ale dla dużych modeli językowych, a nie dla robotów indeksujących. Według Johna Muellera tradycyjna forma wyszukiwania nie zniknie. Poza tym: czy można „dodać” EEAT do swojej strony (i dlaczego nie), a także nowości w Google News.

1. March Core Update już za nami

Dokładnie 27 marca zakończyło się wdrażanie ostatniej, marcowej aktualizacji algorytmu. Trwała ona dwa tygodnie – czyli raczej standardowo.

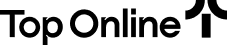

Tak samo jak przy poprzednich zmianach, także teraz specjaliści od pozycjonowania i pozostali eksperci z branży SEO/SEM obserwowali mniejsze lub większe wahania w widoczności stron z różnych branż.

Pozycje niektórych witryn poleciały w górę, inne pospadały – rzekłbym, klasyka :).

Ale żeby nie była tak nudno – trafiłem na krótki artykuł przygotowany przez CEO Local SEO Guide, Andrew Shotlanda, w którym prezentuje swoje wnioski dotyczące tej aktualizacji.

Shotland zauważył m.in. mocne spadki w przypadku treści na forach – choć np. Reddit utrzymał swoją dominującą pozycję, inne witryny zaczęły tracić wcześniej zbudowaną widoczność.

Druga rzecz: kary za tzw. programmatic content, czyli treści tworzone stricte pod SEO, w dużych ilościach i bez większej wartości dla użytkowników.

I w końcu po trzecie – Shotland zauważył, że March Core Update miał wpływ na wiele sektorów, m.in. branżę detaliczną, strony rządowe czy wydawców. Czyli miał dość szeroki zakres, w przeciwieństwie do niektórych poprzednich aktualizacji.

Z danych pozyskanych przez Local SEO Guide dowiadujemy się też, że od mniej więcej 10 marca w amerykańskich SERPach mocno się kotłowało. Widoczna była duża niestabilność, jedna z większych w ciągu ostatnich 12 miesięcy.

Oczywiście będę Was informował, jeśli wpadną mi w ręce jeszcze jakieś konkrety dotyczące efektów marcowej aktualizacji od Google.

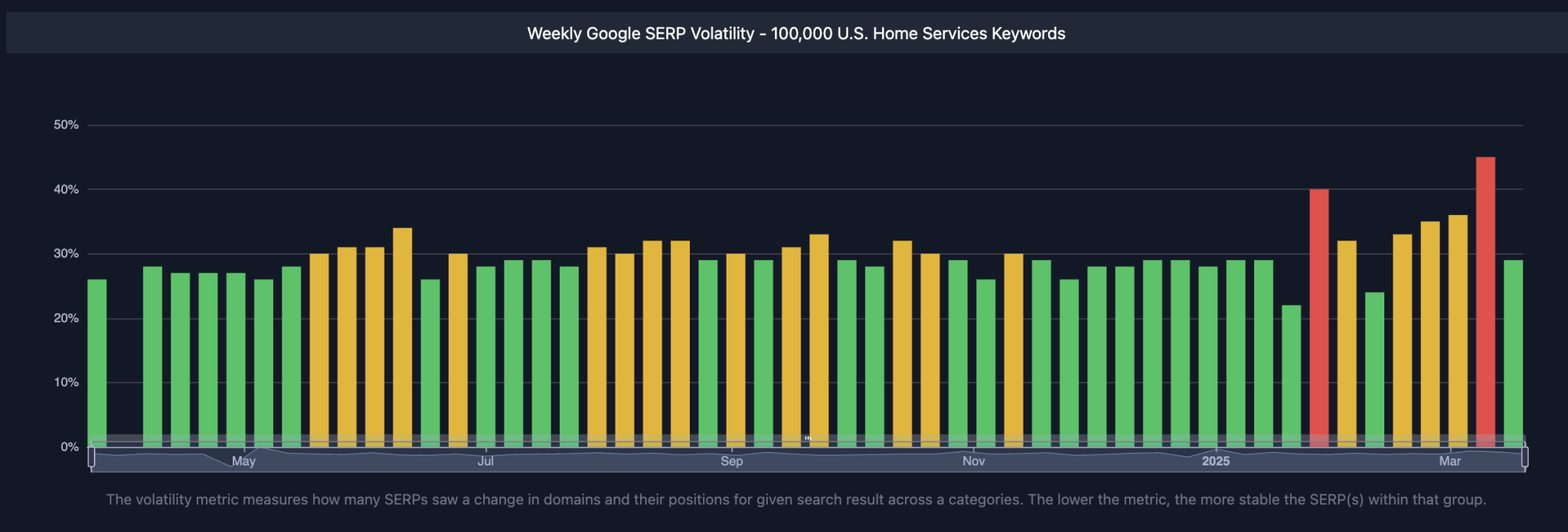

2. Koniec funkcji Google AI while browsing

Google rezygnuje z jednej ze swoich funkcjonalności opartych na sztucznej inteligencji. Chodzi o Google AI, znane też jako [SGE while browsing](https://toponline.pl/blog/seo-news-97) lub AI while browsing.

Mamy AI Overviews, mamy Tryb AI w wyszukiwarce – może warto przypomnieć, czym była funkcja Google AI?

Pozwalała ona tworzyć bullet listy/krótkie podsumowania treści zawartych na danej stronie i uzupełniać je o informacje z wyników wyszukiwania. Mogła także odpowiadać na dodatkowe pytania użytkowników.

Oficjalny powód usunięcia tej funkcji nie jest znany. Google napisało tylko, że „funkcja AI podczas przeglądania nie jest już dostępna”.

Przy okazji opis tej funkcji zniknął z oficjalnej dokumentacji paywalla.

Domyślam się, że jest to doskonała wiadomość dla wielu wydawców i właścicieli stron, którzy narzekali, że taka „nakładka” AI zniechęca użytkowników do samodzielnego czytania tekstów – podrzucając im szybkie podsumowania najważniejszych punktów i zagadnień.

3. LLMs.txt – nowy standard indeksowania?

Czy jesteśmy świadkami rewolucji w kontekście dostępu dużych modeli językowych (LLM) do zawartości stron www?

Raczej za wcześnie, żeby rzucać takie deklaracje – ale według mnie to naprawdę gorący news i potencjalnie pierwszy krok na drodze do standaryzacji indeksowania AI.

LLMs.txt – tak może wyglądać plik tekstowy, dzięki któremu ChatGPT, Gemini czy Perplexity będą w stanie odczytać treści witryn i zawrzeć je w wynikach wyszukiwania opartych na sztucznej inteligencji.

Taki standard został zaproponowany przez australijskiego technologa Jeremy’ego Howarda. Plik ma zawierać najważniejsze informacje dotyczące strony i działać na podobnej zasadzie jak robots.txt.

Różnica jest taka, że zamiast kontrolować dostęp robotów indeksujących, llms.txt ma koncentrować się na dostarczaniu skondensowanych, eksperckich informacji z witryny w formacie przyjaznym dla tych modeli.

Może to obejmować pełne teksty stron, podsumowania czy listy URL-i, co pozwoli właścicielom witryn na lepszą kontrolę nad tym, jakie treści będą wykorzystywane przez AI.

Nie będzie więc możliwości blokowania indeksowania za pomocą dyrektyw, a raczej opcja wyboru, które elementy strony mogą być wyświetlane kontekstowo lub w całości w narzędziach AI.

Wnioski na świeżo? Jak dla mnie wprowadzenie llms.txt może przynieść wiele korzyści w zakresie optymalizacji pod kątem AI (czyli już nie SEO, a GEO/AEO), poprawiając interakcje modeli językowych z witryną i zwiększając widoczność treści w wynikach wyszukiwania opartych na AI.

W konsekwencji może się też zwiększyć ruch AI z różnych narzędzi LLM i czatbotów.

Na dalsze, konkretniejsze analizy przyjdzie jeszcze czas. Zobaczymy, jak to wszystko będzie się rozwijać.

4. Google twierdzi, że AI nie zastąpi tradycyjnego wyszukiwania

Taka deklaracja padła z ust Johna Mueller podczas wydarzenia Search Central Live w Nowym Jorku.

To oczywiście tylko ułamek jego wypowiedzi. Mueller omawiał krajobraz wyszukiwania w szerszym kontekście i choć podkreślił, że według niego jego klasyczna forma nie zniknie (czyt. wyszukiwarka Google), to jednak narzędzia AI z pewnością mocno namieszają.

To z kolei będzie wymagało dostosowania się do nowych technologii i zmieniających się trendów.

Tylko czy aby na pewno jest to coś nowego? Prawda jest taka, że praca w SEO zawsze wiązała się z koniecznością poszerzania horyzontów i ciągłego doskonalenia się w różnych dziedzinach.

Kto stał w miejscu, w końcu przegrywał.

Może chodzi tu bardziej o skalę zmian, bo jednak sztuczna inteligencja wprowadza teraz zupełnie nowe spojrzenie na to, jak korzystamy z internetu i w jaki sposób wyszukujemy informacje. To już nie jest ewolucja, tylko rewolucja.

Wydawcy i właściciele stron powinni dążyć do tego, by ich treści wyświetlały się tam, gdzie użytkownicy będą ich szukać.

Wracając do wypowiedzi Muellera – twierdzi on, że AI będzie jednym z elementów nowego, kompleksowego doświadczenia wyszukiwania, które wkrótce może stać się standardem.

Jednocześnie uważa, że podstawowe zasady SEO jak skanowanie stron czy indeksowanie nadal będą miały duże znaczenie. Według niego rola SEO ewoluuje, a nie zanika.

5. Google: Nie możesz tak po prostu „dodać” EEAT do swojej strony

I znowu odwołuję się do J. Muellera, który na tym samym evencie potwierdził stanowisko Google w sprawie [kryteriów E-E-A-T](https://toponline.pl/blog/seo-news-62) (Experience, Expertise, Authoritativeness, Trustworthiness – Doświadczenie, Ekspertyza, Autorytet, Wiarygodność).

Właściciele stron internetowych czy SEO-wcy nie są w stanie w żaden sposób „umieścić” EEAT w kodzie źródłowym, tak jak można to robić np. ze znacznikami meta.

Po pierwsze dlatego, że nie jest to techniczny element strony, tylko zestaw wytycznych stosowanych przez Google w kontekście stron z kategorii YMYL – dotyczących zdrowia czy finansów.

Po drugie, aby spełnić wymagania EEAT, należy skupić się na długotrwałym budowaniu autorytetu, dostarczając wartościowe, rzetelne, eksperckie treści dla użytkowników.

Oznacza to m.in.:

- Tworzenie treści przez osoby mające faktyczne doświadczenie i wiedzę w danej dziedzinie.

- Podawanie źródeł informacji i linkowanie do wiarygodnych stron.

- Dbanie o to, by treści były aktualne, dobrze napisane i spełniały oczekiwania użytkowników.

Uwierzytelnianie autorów poprzez ich profile, biografie czy odniesienia do innych publikacji.

Mueller podkreślił, że kryteria EEAT są wykorzystywane przez zewnętrznych ekspertów oceniających jakość treści (tzw. quality raters) jako punkt odniesienia.

Zaznaczył też, że nie są one brane pod uwagę w przypadku witryn, które działają poza sektorem YMYL.

Wiadomo, że publikowanie profesjonalnych treści na takich stronach może być korzystne pod kątem wizerunkowym i marketingowym, ale raczej nie ma to bezpośredniego przełożenia na rankingi Google.

6. Google News ze stronami publikacji generowanymi automatycznie

Google zaktualizowało dokumentację dot. Google News i poinformowało o przejściu na automatycznie generowane strony publikacji.

Ta zmiana ma pomóc w optymalizacji procesu obsługi wydawców i uprościć korzystanie z usługi Google News.

Z bardziej technicznych rzeczy – Google przestaje korzystać z kanałów RSS i lokalizacji internetowych przesłanych do Publisher Center. Strony utworzone ręcznie przez wydawców nie będą dłużej wyświetlane.

Google zapewnia, że ten update nie wpłynie na widoczność contentu w ich usłudze ani na innych platformach newsowych.

Dla zainteresowanych podrzucam link do zaktualizowanej dokumentacji tutaj.