Hit tego tygodnia: Google udostępniło kompletnie nowe API Search Console! W wynikach wyszukiwania zobaczymy teraz statystyki ruchu na podstronach i co ciekawe, nie jest to żaden błąd, a nowa funkcja. Jest też ważna wiadomość dla publikujących w Google News: firma wzięła się za kontrolę, sypią się kary ręczne.

1. Nowe API Google!

Zdecydowanie news numer jeden w minionym tygodniu. Bez żadnych szczególnych zapowiedzi czy wcześniejszych sygnałów, Google udostępniło API dla narzędzia sprawdzania adresów URL dostępnego w Search Console. Interfejs zwraca między innymi informacje o statusie i błędach indeksacji poszczególnych URL-i, błędach AMP i danych strukturalnych.

To sporo nowych, niedostępnych dotychczas możliwości, szczególnie w kwestii monitorowania stanu najważniejszych podstron. To także szansa na dalszą automatyzację procesów dla SEO-wców budujących własne oprogramowanie oraz rozbudowę narzędzi dla deweloperów. Co do tego drugiego, mamy już zresztą pierwsze efekty (patrz news niżej).

Jedyny mankament tej nowinki to limit 2000 zapytań na 24h (i 600 na minutę). Z oficjalnym ogłoszeniem Google możesz zapoznać się na blogu Search Central. Dokumentacja jest z kolei dostępna pod linkiem: https://developers.google.com/webmaster-tools/v1/urlInspection.index/inspect. Zachęcamy do sprawdzenia i testów!

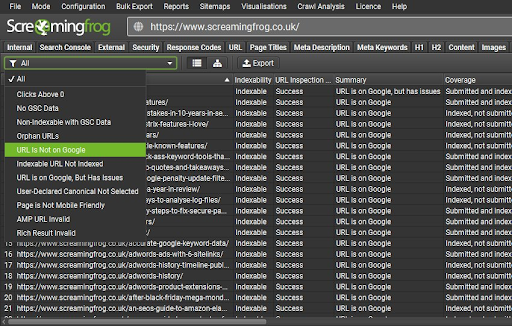

2. Update Screaming Frog - integracja nowego API

W zaledwie trzy dni po opublikowaniu API dla narzędzia do sprawdzania URL-i Screaming Frog wdrożył i opublikował integrację nowinki ze swoim crawlerem. W związku z nią w narzędziu pojawiło się 7 nowych filtrów danych z Search Console. Pozwolą nam one na audytowanie nie tylko błędów indeksacji, ale też m.in. przyjęcia przez Google canonicala innego niż pierwotnie wskazany czy problemów z rich snippets.

Co ciekawe, w oficjalnej informacji o aktualizacji do wersji 16.6 firma zapowiada, że to dopiero pierwsza część nowych funkcji, wskazując przy tym na to, że narzędzie nie uwzględnia jeszcze wszystkich danych. Zachęca też do wypowiedzi na temat wrażeń i doświadczeń dot. nowości, przyznając jednocześnie, że mogą one wymagać jeszcze dopracowania. Mimo wszystko, tempo aktualizacji naprawdę godne podziwu.

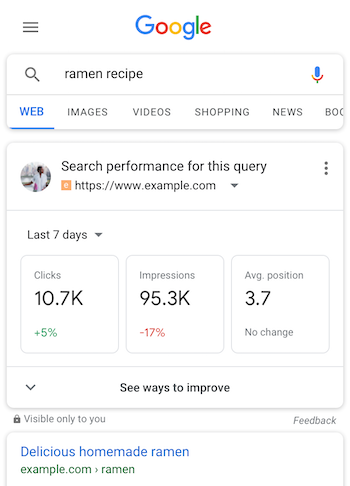

3. Dane z Search Console w wynikach wyszukiwania

Każdy, kto posiada podpięcie Google Search Console swojej strony lub pracuje na koncie pełnego użytkownika, zobaczy teraz w wynikach wyszukiwania podgląd danych o ruchu. Funkcja ta będzie widoczna na frazach, na których nasz serwis jest widoczny w rankingu. Można by doszukiwać się tutaj wygodnego dostępu do danych czy innych korzyści, ale naszym zdaniem jej głównym celem jest po prostu zachęcenie do aktywniejszego korzystania z konsoli.

Część z Was mogła spotkać się już z takim widokiem. Funkcja wyświetlania danych o ruchu w wyszukiwarce nie jest bowiem nowa. Pojawiła się pierwotnie w 2018 roku, ale nie została zaktualizowana po wprowadzeniu usługi domeny w Google Search Console. Wraz z drobnym redesignem nastąpiło to właśnie teraz. Kartę z danymi o ruchu zobaczą więc znowu wszyscy korzystający z konsoli.

Co ważne, jeśli nie chcesz widzieć takich kart, możesz je wyłączyć. Wystarczy zalogować się do GSC i wejść w ustawienia użytkownika (prawy górny róg). Zarządzanie funkcją jest dostępne w zakładce “Search Console w wynikach wyszukiwania”. Bezpośredni link do opcji: https://search.google.com/search-console/user-settings/performance-on-search.

4. Kary ręczne w Google News

Mniej więcej w rocznicę dodania nowych typów kar ręcznych dla Google News oraz Google Discover, firma wzięła się poważnie za analizę stron pod kątem przestrzegania wytycznych.

W zeszłym tygodniu wokół praktycznie wszystkich najpopularniejszych kont na Twitterze pojawiły się doniesienia o karach ręcznych, głównie dot. Google News. Filtrów sypie się całkiem sporo, a jest to zapewne efekt tego, że wielu wydawców przywykło już do nikłej moderacji, jednocześnie coraz bardziej przymykając oko na dokładne trzymanie się wytycznych.

Cóż, jeśli działacie w obrębie Google News lub Discover, polecamy przeprowadzić mały audyt treści w odniesieniu do polityki i zasad Google News. Upewnijcie się, że nie naruszacie wytycznych. Pełną listę kar ręcznych i wskazówek rozwiązywania problemów będących ich przyczynami znajdziecie na stronach pomocy Google.

5. Google masowo zmienia title tagi naszych stron

A właściwie, wyświetla ich zmodyfikowane lub wygenerowane kompletnie od nowa wersje. Badanie przeprowadzone ostatnio przez Zyppy.com wykazało, że Google zmienia w jakimś stopniu aż 61,6% wszystkich wyświetlanych meta title. Analizie poddano ponad 80 tys. meta tagów z 2370 różnych serwisów.

Większość osób zajmujących się pozycjonowaniem zdaje sobie doskonale sprawę z tego, że algorytm Google może zmienić wyświetlany title. Wtedy, gdy uzna go za nieadekwatny lub zbyt mało informacyjny do danego zapytania. Dotąd praktycznie nikt nie zdawał sobie jednak sprawy z tego, jak często się to tak faktycznie dzieje.

61,6% to dość szokująca liczba, szczególnie jeśli weźmiemy pod uwagę to, jak dużą rolą na efekty naszych podstron może mieć ich widoczny w SERP-ach tytuł. Z tego samego względu, dla wielu osób wkładających swój czas i wysiłek w ręczny dobór tagów może to być też zwyczajnie frustrujące. Co jednak ciekawe wśród wniosków możemy przeczytać o najważniejszych statystycznie czynnikach wpływających na podjęcie decyzji o zmianie.

W telegraficznym skrócie, jeśli chcesz zachować oryginalny title w wyszukiwarce, powinieneś/aś:

- zachować długość title w przedziale 50-60 znaków ze spacjami,

- nie używać w nim nawiasów,

- ograniczać separatory takie jak myślniki, dywizy, pauzy czy kreski pionowe,

- nie używać nadmiernie słów kluczowych,

- nie używać nazw firm i marek bez potrzeby,

- stosować taki sam nagłówek H1 jak meta title.

6. Wymiana linków nie zawsze jest zła

Ciekawostka z Google SEO office hours: wzajemne linkowanie do siebie dwóch portali nie zawsze jest uznawane przez wyszukiwarkę za próbę manipulacji rankingiem. W wielu przypadkach takie umieszczanie odnośników może być zupełnie naturalne. Algorytm Google to rozumie i co najważniejsze, uwzględnia.

John Mueller wyjaśnił to przy pytaniu dotyczącym tego, czy linki przychodzące do strony stracą wartość w momencie zamieszczenia na niej odnośników do linkujących domen. Jak się okazuje, choć czysto technicznie takie linkowanie mogłoby być uznane za wymianę linków (Black Hat SEO), w wielu przypadkach jest zupełnie naturalne.

Wraz z nową wersją systemu i nowym rokiem, tradycyjnie już, pojawił się też nowy domyślny szablon WordPressa - “Twenty Twenty-Two” (2022). Co ciekawe, jest to szablon blokowy, dostosowany do nowego edytora. Inne, kompatybilne aktualnie z nowym Gutenbergiem szablony to m.in. Astra oraz GeneratePress.

Przykładem mogą być choćby witryny biznesów lokalnych, które linkują do siebie nawzajem choćby ze względu na współpracę lub serwisy, które linkują do wspominających o nich wpisów na portalach informacyjnych. Mueller podsumował to w ten sposób: “Jeśli robisz coś naturalnie, bez żadnych dziwnych układów za kulisami, to naprawdę nie ma się czym przejmować”.

7. Aplikacja SEO dla stron na Wix’ie

Deepcrawl, czyli międzynarodowa firma dostarczająca rozbudowane narzędzia SEO w modelu SaaS, stworzyła specjalną aplikację SEO dostosowaną do stron stworzonych na Wix’ie. Aplikacja została zaprojektowana dla małych i średnich biznesów. Jej główną funkcją jest automatyczne, cotygodniowe crawlowanie serwisu, wykrywające liczne błędy, od niedziałających URL-i (404) po treści łamiące wytyczne dla webmasterów.

Rozwiązanie jest dostępne w dość korzystnej cenie - 7 USD za miesiąc. Niestety nie wiemy na razie za wiele o jego jakości. Póki co nie ma zbyt wielu opinii, a sami też nie mieliśmy okazji przetestować. Jeśli prowadzicie jednak serwis zbudowany na Wix lub zajmujecie się SEO takowego, warto sprawdzić. Narzędzie jest dostępne poprzez Wix App Market.

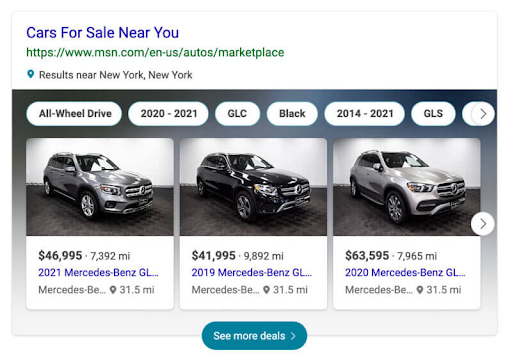

8. Bing dodaje wyróżnienia w wynikach dot. motoryzacji i samochodów

W Bing pojawią się nowe rozszerzenia wyników wyszukiwania. Tym razem będą one dotyczyć przede wszystkim samochodów i co ciekawe, poza ofertami salonów, będą też powiązane ściśle z internetowym rynkiem aut używanych. Firma ogłosiła to na swoim blogu. Nowa funkcja ma za zadanie ułatwić użytkownikom poszukiwania samochodów, wygląda zresztą całkiem obiecująco.

Niestety, news ten zamieszczamy wyłącznie w ramach ciekawostki (no, chyba że mieszkacie w Stanach lub działacie na tamtejszym rynku samochodów używanych). Jak wiadomo, Bing nie cieszy się u nas zbyt wielką popularnością. Nowy feature w wynikach prezentuje też głównie oferty zamieszczane na MSN Autos Marketplace. Pozostaje nam więc zastanawiać się, czy Google podchwyci pomysł.