CTR powoli wzrasta po spadkach spowodowanych wprowadzeniem AIO. Bing zapowiada nowe raporty i funkcje AI. Google chce opisać nieobsługiwane i błędne reguły robots.txt. Oprócz tego Liz Reid o wpływie AI na wyszukiwanie i zachowania użytkowników, a także rozmyślania nad „contentem wysokiej jakości” – co to właściwie oznacza i jak pomaga zwiększać widoczność?

1. CTR wraca do żywych! AI Overviews jednak nie takie straszne?

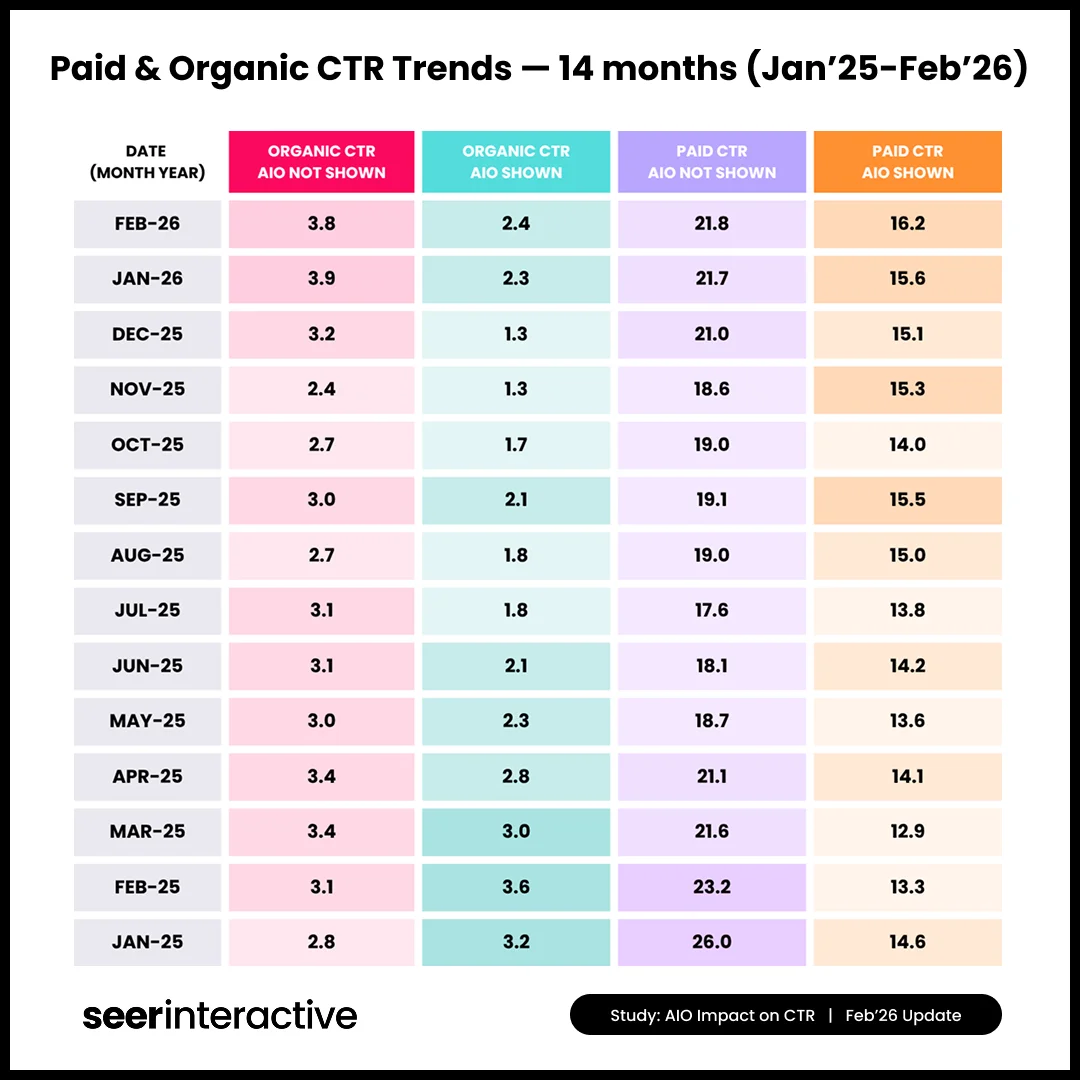

AI Overviews były dla wielu stron jak zimny prysznic – widoczność rosła, ale kliknięcia spadały. Najnowsze dane od Seer Interactive pokazują jednak, że sytuacja zaczyna się stabilizować.

CTR, który pod koniec 2025 roku osiągnął poziom 1,3%, w kolejnych miesiącach przekroczył 2% (dokładnie 2,4%). Może nie wygląda to jakoś spektakularnie, ale mówimy o różnicy na poziomie ok. 85%.

To oczywiście nie znaczy, że problem zniknął, bo ruch nie wraca w równym stopniu do wszystkich stron. Przeciwnie – jeszcze wyraźniej widać podział na tych, którzy pojawiają się w AIO i zyskują dodatkowe kliknięcia, oraz tych, którzy zostają pominięci i tracą więcej niż wcześniej.

Słychać opinie, że te zmiany w CTR są raczej korektą po mocnym spadku, a nie powrotem do normalności.

Warto wiedzieć

Sprawdź badanie Seer Interactive: AIO Impact on Google CTR: 2026 Update

Zmienia się też zachowanie samych użytkowników, którzy coraz częściej zatrzymują się na odpowiedzi podanej przez Google i klikają tylko wtedy, kiedy rzeczywiście potrzebują więcej informacji.

To sprawia, że ruch, choć mniejszy, może być bardziej wartościowy – na stronę trafiają osoby z konkretną intencją, a nie przypadkowi użytkownicy przeglądający wyniki.

No i nie zapominajmy, że zapytania bez AI Overviews nadal generują wyższy CTR, co dodatkowo pokazuje, jak duży wpływ na sposób konsumowania treści ma obecnie sztuczna inteligencja.

2. Zapowiedź nowych raportów AI od Microsoftu

Microsoft zapowiada kolejne zmiany w Bing Webmaster Tools, które mają pomóc lepiej zrozumieć, jak strony internetowe funkcjonują w wynikach opartych na sztucznej inteligencji.

Zobacz też:

Nowości koncentrują się na 3 obszarach:

- „Citation share”, czyli udział cytowań – wskaźnik, który ma pokazywać, jak duży udział w odpowiedziach AI ma dana strona lub domena. To rozwinięcie dotychczasowego podejścia, które skupiało się głównie na liczbie cytowań.

- Analiza intencji zapytań („grounding query intent”) – Bing ma wprowadzić zestaw predefiniowanych typów intencji (około 15), które pozwolą lepiej zrozumieć, w jakim kontekście treści są wykorzystywane przez AI. Innymi słowy, nie tylko zobaczysz, że Twoja strona została użyta, ale też dlaczego – czy odpowiada na pytanie informacyjne, zakupowe, nawigacyjne czy inne.

- Rekomendacje związane z GEO – narzędzie ma sugerować działania optymalizacyjne pod kątem wyszukiwarek generatywnych, a nie tylko klasycznych wyników wyszukiwania.

To na razie tylko teaser – funkcje nie są jeszcze dostępne publicznie, nie znamy też szczegółów wdrożenia.

3. Nieobsługiwane reguły pliku robots.txt – szykują się zmiany w dokumentacji?

Google planuje uporządkować temat robots.txt, ale zamiast wprowadzać nowe zasady, chce przede wszystkim lepiej pokazać, co nie działa w kontekście pozycjonowania i widoczności.

Chodzi o rozszerzenie listy dyrektyw, które są przez Googlebota ignorowane, mimo że wciąż pojawiają się w plikach na wielu stronach. To efekt analizy danych z prawdziwych witryn, a nie tylko założeń teoretycznych.

Firma przyjrzała się milionom plików robots.txt i szybko okazało się, że poza podstawowymi dyrektywami, takimi jak user-agent, allow czy disallow, reszta zapisów ma marginalne znaczenie albo jest po prostu błędna.

W wielu przypadkach są to rozwiązania kopiowane od lat, które nigdy nie były wspierane, ale mimo to funkcjonują w ogólnym obiegu. Google nie zamierza ich obsługiwać, chce natomiast jasno wskazać, że nie mają żadnego wpływu na indeksowanie.

Bardzo ciekawą kwestią są też nagminne błędy w zapisie kluczowych reguł.

Analiza ujawniła, że ludzie często robią literówki – ale zamiast z tym walczyć, Google chce zwiększyć tolerancję na takie sytuacje. Mówimy więc o potencjalnym dostosowaniu parsera do realnych zachowań użytkowników, a nie odwrotnie.

4. Liz Reid z Google o zmianach w wyszukiwaniu w erze AI

Liz Reid pojawiła się ostatnio w jednym z podcastów Bloomberga, gdzie podzieliła się swoimi przemyśleniami odnośnie do sztucznej inteligencji i zmian wynikających z popularności tej technologii.

Warto wiedzieć

Sprawdź wywiad z Liz Reid: Google's Liz Reid on Who Will Own Search in a World of AI | Odd Lots

Zebrałem najważniejsze wnioski w poniższej liście:

- Ewolucja zapytań – użytkownicy coraz rzadziej wpisują krótkie, hasłowe frazy, a częściej zadają dłuższe, bardziej złożone pytania przypominające naturalny język. To efekt interakcji z systemami AI, które zachęcają do bardziej konwersacyjnego stylu.

- AI Overviews nie mają zastępować stron internetowych, ale raczej pełnić rolę pierwszego punktu styku z informacją. Użytkownik dostaje szybką odpowiedź i dopiero wtedy decyduje, czy chce się zagłębić w temat.

- Dzięki AIO kliknięcia stają się bardziej świadome i mniej przypadkowe. Ruch może być mniejszy, ale za to często jest lepiej dopasowany do intencji.

- Google dostrzega skalę zjawiska „AI slop” i deklaruje walkę z contentem tworzonym bez realnej wartości dla użytkownika.

- Mimo zmian w sposobie wyszukiwania model biznesowy Google pozostaje stabilny, ponieważ większa liczba zapytań rekompensuje zmiany w zachowaniu użytkowników. AI nie eliminuje więc przestrzeni reklamowej, tylko ją przekształca.

- Zmiany, które obserwujemy, mają przede wszystkim charakter behawioralny. To nie sama technologia redefiniuje wyszukiwanie, ale sposób, w jaki ludzie zaczynają z niej korzystać.

5. Czy AI faktycznie nagradza content wysokiej jakości?

Trafiłem ostatnio na bardzo fajną analizę, która rozkłada na czynniki pierwsze jedną z najczęściej powtarzanych tez w SEO: że wysokiej jakości, oryginalny content automatycznie przekłada się na lepsze wyniki – zarówno w Google, jak i w odpowiedziach AI.

Problem zaczyna się już na poziomie samej definicji. Samo pojęcie „high-quality content” okazuje się niejednoznaczne i często używane jako skrót myślowy bez żadnego znaczenia.

Dla jednych jakość to głęboka analiza i eksperckość, dla innych forma, struktura albo atrakcyjna prezentacja. To sprawia, że trudno w ogóle mierzyć wpływ „jakości” na wyniki, skoro nie ma jednej spójnej definicji.

Z dostępnych danych wynika, że oryginalność może pomagać, ale nie jest gwarancją sukcesu. Lepiej sprawdza się w przypadku zapytań wymagających interpretacji, opinii czy analizy, gdzie własna perspektywa ma rzeczywiście dużą wartość.

W prostych pytaniach faktograficznych znaczenie unikalności wyraźnie spada, a ważniejsze staje się dopasowanie do intencji i poprawność informacji.

Co ciekawe, w wielu przypadkach o sukcesie nie decyduje jakość, ale moment publikacji. Treści, które pojawiają się jako pierwsze w nowym temacie, mogą zdobyć wysoką widoczność i utrzymać ją nawet wtedy, gdy później pojawią się lepiej dopracowane materiały.

To pokazuje, że szybkość działania i umiejętność wychwytywania trendów mogą być równie ważne, co sam poziom contentu.

W kontekście AI pojawia się jeszcze jeden istotny aspekt. Modele językowe potrafią agregować i przetwarzać istniejące informacje, ale nie tworzą nowych doświadczeń czy perspektyw.

Dlatego bycie pierwotnym źródłem wiedzy – dostarczanie czegoś, czego wcześniej nie było – może zwiększać szanse na cytowania w odpowiedziach AI, choć nadal nie daje gwarancji sukcesu.