Google ostatecznie rezygnuje z rozszerzonych wyników FAQ w wynikach wyszukiwania. Reklamy w ChatGPT z nowymi możliwościami analityki i kontroli nad kampaniami. Ahrefs sprawdza, czy schema faktycznie wpływa na lepszą widoczność w odpowiedziach AI. Oprócz tego: Microsoft twierdzi, że systemy AI wymagają lepszego indeksu wyszukiwania, a Google pracuje nad nowym protokołem kryptograficznym do weryfikacji botów internetowych.

1. Google rezygnuje z FAQ rich results

Google definitywnie kończy wsparcie dla FAQ rich results. Od 7 maja rozszerzone wyniki z pytaniami i odpowiedziami przestały być wyświetlane w wyszukiwarce.

A to oznacza, że nawet poprawnie wdrożone dane strukturalne FAQPage nie mają już żadnego wpływu na wygląd wyników w SERP-ach.

Zmiana nie ogranicza się tylko do samej wyszukiwarki – Google stopniowo usuwa cały ekosystem powiązany z tą opcją. W czerwcu znikną raporty FAQ w Search Console oraz narzędzia do testowania rich results, a w sierpniu wyłączona zostanie również obsługa FAQ przez API.

Dla wielu specjalistów od pozycjonowania nie jest to jednak zaskoczenie. Już wcześniej Google mocno ograniczało wyświetlanie FAQ rich results, pozostawiając je głównie dla wybranych stron, m.in. serwisów rządowych czy medycznych.

Funkcja nadal może mieć sens jako element porządkujący treść na stronie, ale nie przełoży się już na większą powierzchnię wyniku w Google ani CTR. Według przedstawicieli firmy nie trzeba podejmować żadnych działań, choć w wielu przypadkach utrzymywanie tego typu danych strukturalnych przestaje mieć praktyczne uzasadnienie.

Ważna uwaga: mówimy wyłącznie o FAQ rich results – a nie o sekcji People Also Ask. To dwa odrębne systemy w Google.

2. Nowości w ChatGPT Ads

Reklamy w ChacieGPT wchodzą w nowy etap rozwoju – i w końcu zaczynają przypominać pełnoprawne, działające narzędzie.

Jedną z najważniejszych nowości jest tzw. self-serve Ads Manager. Funkcja ta pozwoli firmom samodzielnie kupować i zarządzać kampaniami reklamowymi bez udziału pośredników – czyli agencji marketingowych.

Odświeżony menedżer reklam oferuje opcje dobrze znane z najpopularniejszych platform takich jak Google Ads czy Meta Ads. Reklamodawcy mogą ustawiać budżety, zarządzać stawkami, kontrolować tempo wydatków, tworzyć kreacje reklamowe i analizować wyniki kampanii w jednym miejscu.

Zobacz też:

Równolegle rozwijane są narzędzia pomiarowe, w tym tracking oparty na pikselach i integracje z Conversion API, które umożliwiają śledzenie działań użytkowników po kliknięciu reklamy.

Poza tym dostajemy nowy model rozliczeń – CPC, który uzupełnia wcześniejszy model CPM. To akurat ważna zmiana dla specjalistów od performance marketingu, bo pozwala lepiej kontrolować efektywność kampanii.

Do tej pory reklamy w ChatGPT działały głównie w modelu pilotażowym. Dostęp do platformy był ograniczony, kosztowny i skierowany przede wszystkim do dużych marek oraz agencji. Teraz ma się to zmienić, bo OpenAI chce otworzyć ekosystem również dla mniejszych firm, startupów i reklamodawców, którzy do tej pory nie mieli dostępu do tej formy promocji.

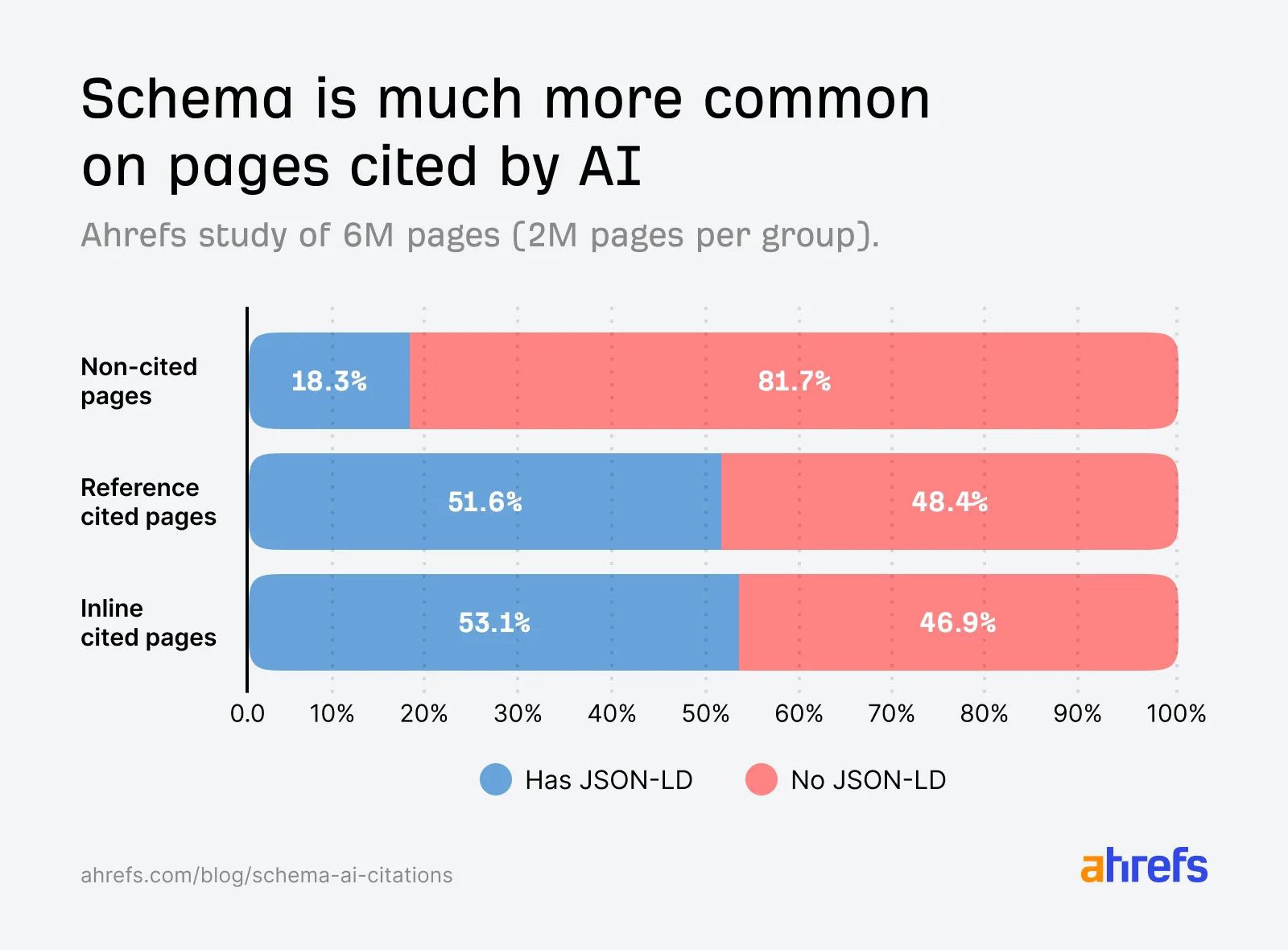

3. Jak schema wpływają na cytowania w AI? Ahrefs to sprawdził

Nowe badanie wykonane przez Ahrefs pokazuje, że schema może mieć mniejsze znaczenie w kontekście widoczności w odpowiedziach AI, niż wcześniej zakładaliśmy.

Przeanalizowano dokładnie 1885 stron internetowych, które wdrożyły JSON-LD schema markup. Każdą z nich zestawiono z grupą kontrolną – były w niej podobne witryny, ale bez danych strukturalnych.

Badanie obejmowało okres 30 dni przed wdrożeniem danych schema i 30 dni po ich wdrożeniu. Wyniki okazały się zaskakująco… słabe.

- W przypadku Trybu AI wzrost widoczności wyniósł dokładnie 2,4%.

- W ChatGPT: 2,2%.

- W AI Overviews odnotowano nawet niewielki spadek cytowań na poziomie −4,6%.

Warto wiedzieć

Sprawdź analizę Ahrefsa: We Tracked 1,885 Pages Adding Schema. AI Citations Barely Moved

Ahrefs zaznacza, że te różnice są statystycznie zbyt małe, by uznać je za efekt działania schema markup.

To o tyle istotne, że do tej pory w branży SEO często wskazywano na silną korelację między obecnością schema markup a częstszym pojawianiem się w odpowiedziach AI. Ahrefs zwraca jednak uwagę, że korelacja nie oznacza przyczynowości.

Według autorów badania bardziej prawdopodobne jest to, że strony z wdrożonym schema markup są po prostu lepiej zoptymalizowane całościowo: mają mocniejszy content, wyższy autorytet domeny, bardziej uporządkowaną architekturę informacji itd. I to może być rzeczywisty powód ich lepszej widoczności.

4. Według Microsoftu systemy AI wymagają udoskonalonego indeksu wyszukiwania

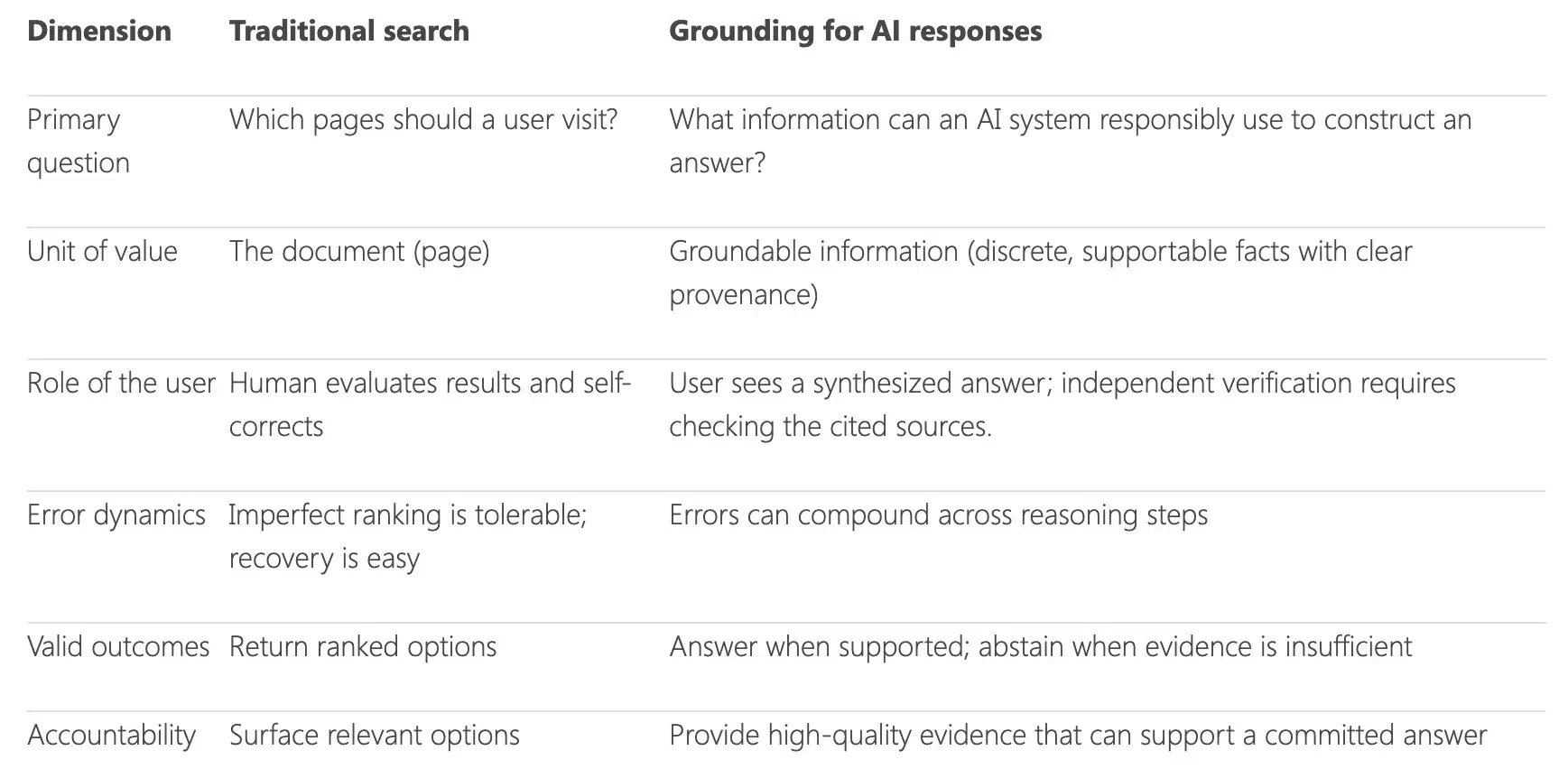

Microsoft uważa, że AI potrzebuje znacznie „mądrzejszego” indeksu niż tradycyjne wyszukiwarki, bo działa zupełnie inaczej – nie tylko pokazuje linki, ale też samodzielnie tworzy odpowiedzi dla użytkownika.

Firma podkreśla konieczność rozróżnienia mechanizmów indeksowania: na tradycyjny vs. tzw. grounding system. Ten drugi opisywany jest jako proces wybierania informacji, które mogą zostać użyte do wygenerowania odpowiedzi AI.

Chodzi więc nie tylko o znalezienie strony pasującej do zapytania użytkownika, ale też o ocenę, czy konkretne informacje są wystarczająco wiarygodne, aktualne i dobrze udokumentowane, aby AI mogło się na nich oprzeć.

Microsoft wskazuje na kilka elementów, które stają się kluczowe w tym nowym modelu indeksowania. System musi ocenić między innymi:

- czy treść nie gubi znaczenia po podziale strony na fragmenty,

- czy źródło informacji jest jasno określone,

- czy dane są aktualne,

- czy najważniejsze fakty można łatwo „wydobyć” i wykorzystać w odpowiedzi,

- czy różne źródła nie są ze sobą sprzeczne.

W tradycyjnej wyszukiwarce użytkownik otrzymywał listę linków i sam decydował, którym źródłom zaufać. W przypadku AI model generuje jedną odpowiedź, przez co ryzyko błędu rośnie.

Jeśli system oprze się na nieaktualnych lub niespójnych danych, to mamy problem nie tylko z niższą pozycją w wynikach, ale też z jakością odpowiedzi, którą widzi użytkownik.

Warto wiedzieć

Sprawdź artykuł na blogu Microsoft Bing: Evolving role of the index: From ranking pages to supporting answers

5. Google testuje nowy standard autoryzacji botów sieciowych

Czy wkrótce otrzymamy nową metodę uwierzytelniania botów odwiedzających nasze strony?

Google pracuje nad eksperymentalnym standardem Web Bot Auth, który ma umożliwić właścicielom witryn łatwiejsze odróżnianie prawdziwych crawlerów od botów podszywających się pod znane usługi.

Dzisiaj weryfikacja opiera się głównie na analizie adresów IP i user-agentów, ale to coraz częściej okazuje się niewystarczające. Wiele nieautoryzowanych systemów bez problemu udaje Googlebota czy inne popularne crawlery, żeby ominąć blokady i limity ruchu.

Nowy standard ma rozwiązać ten problem dzięki wykorzystaniu zaawansowanej kryptografii. Boty będą mogły podpisywać swoje żądania cyfrowo, a serwery zyskają możliwość sprawdzenia, czy dany ruch faktycznie pochodzi z deklarowanego źródła.

Google udostępniło wstępną dokumentację i zbiera opinie od deweloperów oraz administratorów stron. Na razie rozwiązanie znajduje się na wczesnym etapie testów i nie jest jeszcze oficjalnym standardem.